DeepSeek AI ha presentado un adelanto de su serie DeepSeek-V4, introduciendo dos modelos de lenguaje masivos basados en la arquitectura Mixture-of-Experts (MoE), capaces de procesar una longitud de contexto de un millón de tokens, según la documentación disponible en Hugging Face.

La nueva gama incluye el DeepSeek-V4-Pro, un modelo de gran envergadura que presume de un total de 1,6 billones de parámetros (con 49.000 millones activados), y el DeepSeek-V4-Flash, una versión más ágil de 284.000 millones de parámetros con 13.000 millones de parámetros activos.

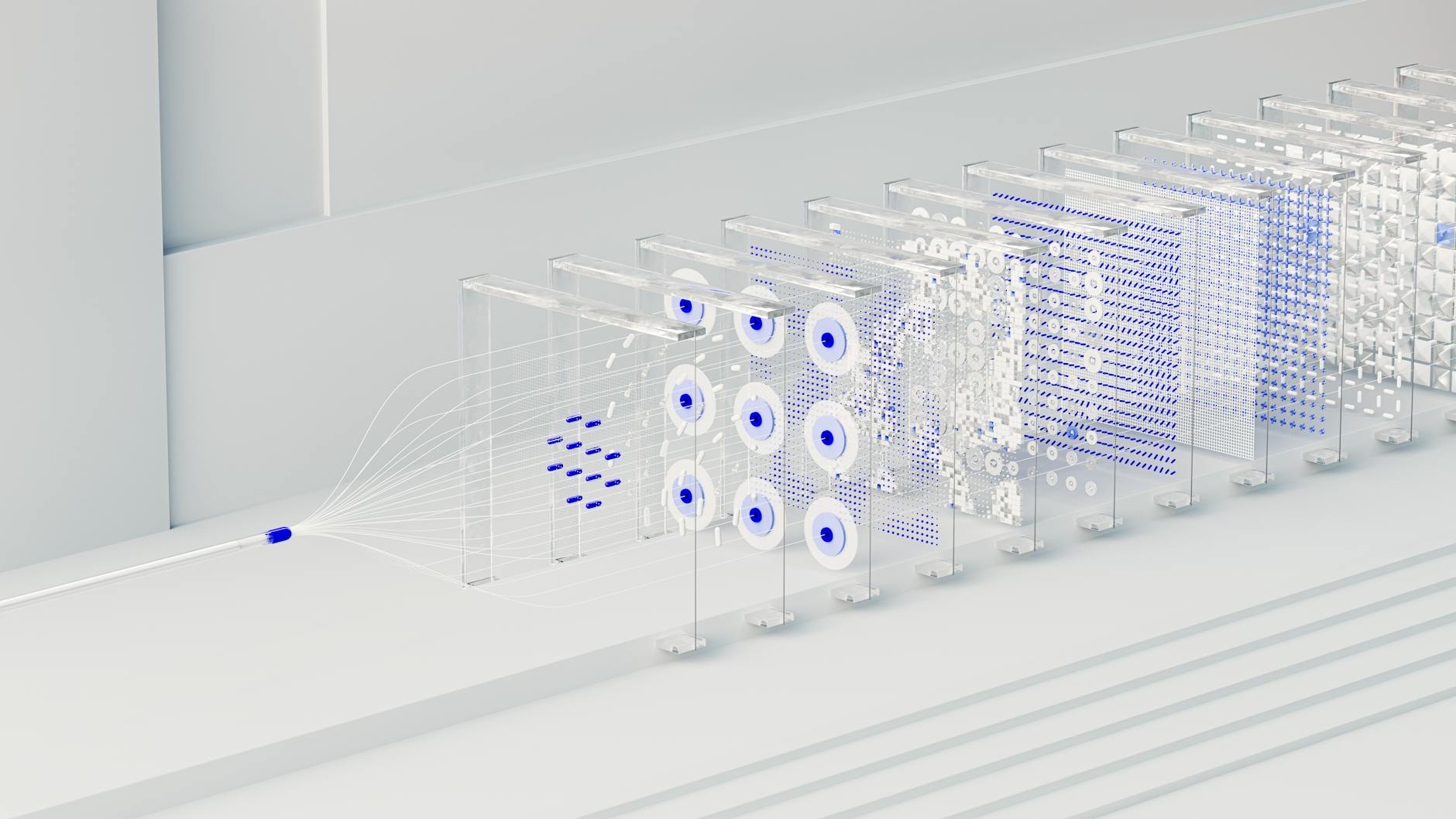

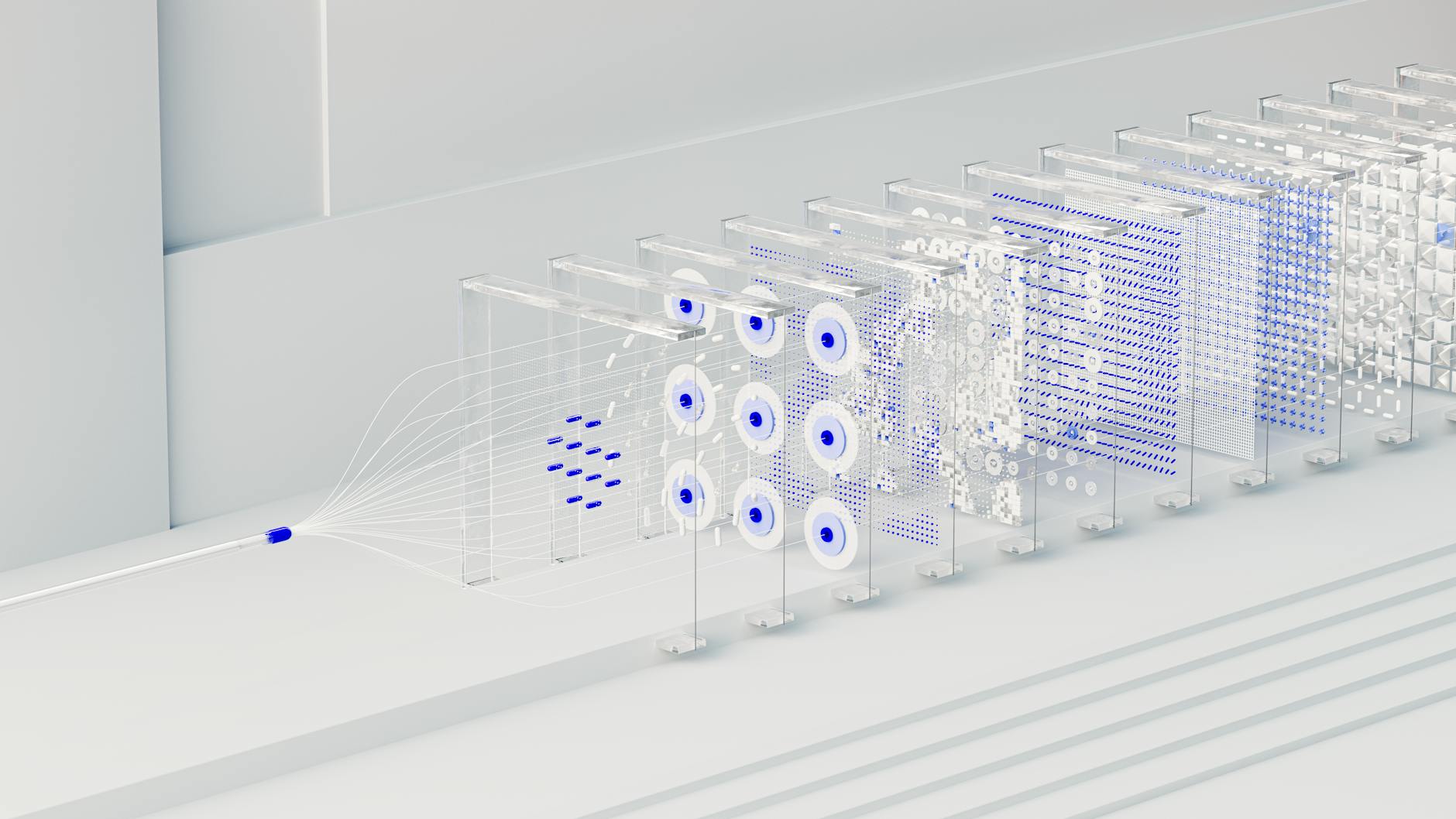

Para gestionar esta enorme ventana de contexto, los desarrolladores han implementado una arquitectura de atención híbrida. Este sistema combina la Atención Dispersa Comprimida (CSA) y la Atención Fuertemente Comprimida (HCA) para optimizar la eficiencia en contextos largos.

Según el informe técnico, el DeepSeek-V4-Pro requiere solo el 27% de los FLOPs de inferencia por cada token y apenas el 10% de la caché KV en comparación con su predecesor, el DeepSeek-V3.2.

Entrenamiento avanzado y optimización

Los desarrolladores utilizaron el optimizador Muon para lograr una convergencia más rápida y una mayor estabilidad durante la fase de preentrenamiento. Esta etapa consistió en entrenar ambos modelos con más de 32 billones de tokens diversos y de alta calidad.

El proceso de postentrenamiento sigue un paradigma de dos etapas. En primer lugar, DeepSeek cultiva expertos especializados en dominios específicos mediante el ajuste fino supervisado (SFT) y el aprendizaje por refuerzo con Optimización de Política Relativa de Grupo (GRPO).

Posteriormente, el equipo emplea la destilación 'on-policy' para consolidar estas distintas competencias en un único modelo unificado. Este método permite que los modelos integren conocimientos especializados en diversas áreas.

DeepSeek afirma que el modo DeepSeek-V4-Pro-Max, que representa el máximo esfuerzo de razonamiento para la versión Pro, se posiciona como el mejor modelo de código abierto disponible en la actualidad. La compañía informó que este avance mejora significativamente las capacidades de conocimiento y reduce la brecha de rendimiento con los principales modelos de código cerrado en tareas de razonamiento y de agentes.

Aunque la versión Flash es más pequeña, los desarrolladores señalaron que el DeepSeek-V4-Flash-Max puede alcanzar un rendimiento de razonamiento comparable al de la versión Pro si se le asigna un mayor presupuesto de pensamiento. No obstante, la menor escala de parámetros del modelo Flash lo sitúa, de forma natural, por detrás en flujos de trabajo de agentes complejos y tareas de conocimiento puro.

Las especificaciones técnicas del lanzamiento incluyen una combinación de precisión FP4 y FP8 para los parámetros de los expertos MoE. Los modelos ya están disponibles para su descarga a través de Hugging Face y ModelScope.