根据 arXiv.org 上发表的一篇最新论文,由 Jamie Simon 领导的研究团队提出,深度学习的正式科学理论目前正在形成过程中。

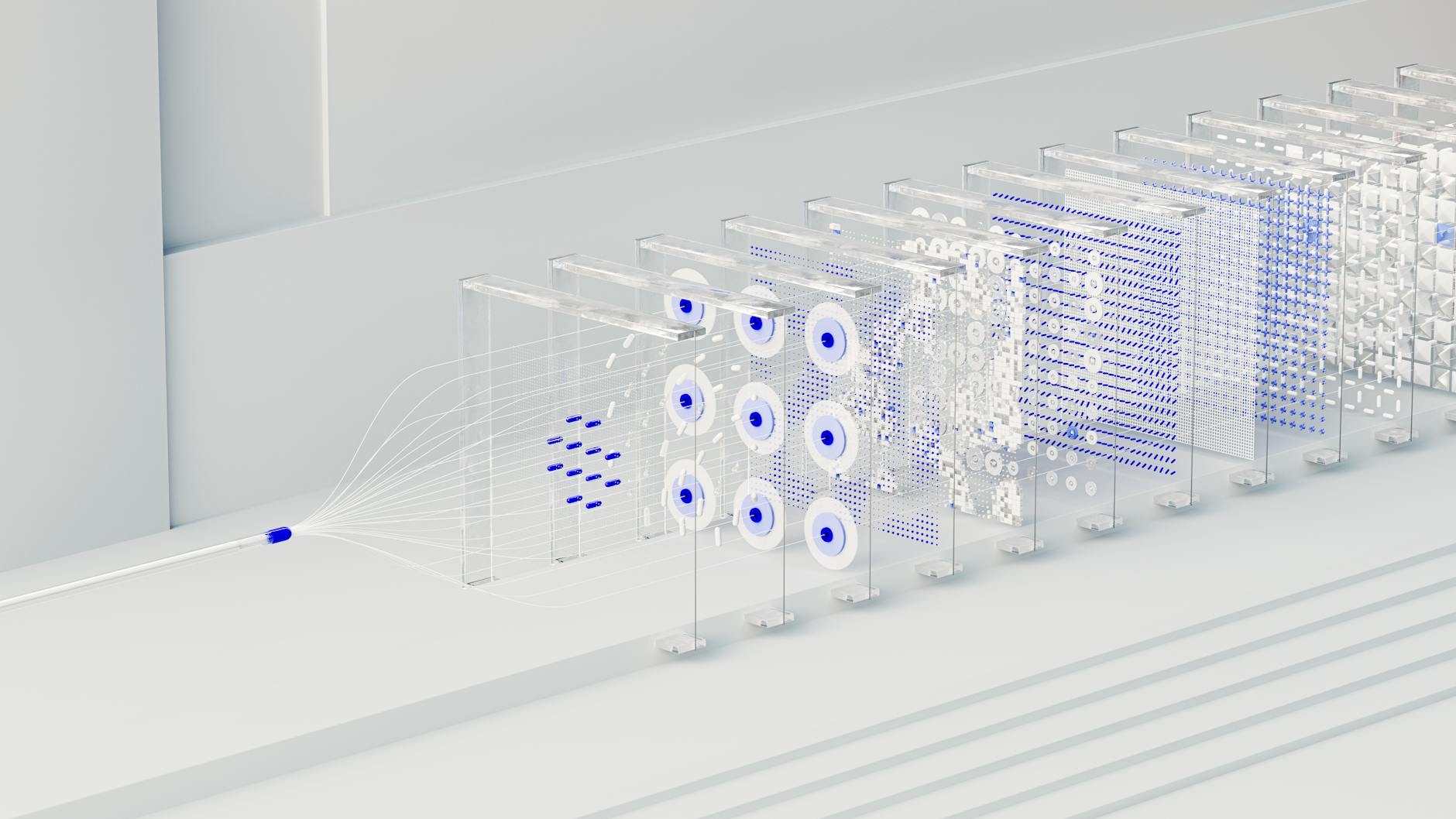

这篇题为《深度学习终将迎来科学理论》(There Will Be a Scientific Theory of Deep Learning)的研究论文认为,神经网络并非不可预测的计算“黑盒”,而是受一种正在兴起的框架所支配,作者将其称之为“学习力学”(learning mechanics)。

论文作者声称,这一新理论能够刻画神经网络训练过程、隐藏层表示以及最终性能的核心属性与统计特征。

为了支持这一观点,研究人员确定了指向统一理论的五个不同研究支柱,包括:可求解的理想化场景、可处理的极限情况、宏观可观测量的简单数学定律、超参数理论,以及不同系统间共有的普遍行为。

向“力学”范式转型

研究人员认为,这一新兴领域最好被理解为一种“学习过程的力学”。该视角侧重于训练过程的动态演变以及对总体统计特征的描述。

作者在论文摘要中指出:“我们认为,这一新兴理论最好被视为一种学习过程的力学。”

论文还强调了“学习力学”视角与“机械可解释性”(mechanistic interpretability)领域之间预期的共生关系。这种联系可以帮助研究人员更深入地理解模型内部特定组件是如何对整体功能做出贡献的。

除了提出新的框架外,作者还回应了学术界对于“深度学习是否存在基础理论”以及“是否有必要建立基础理论”的普遍质疑。这篇长达 41 页的文档最后为未来的研究方向提供了路线图,并为进入该领域的新研究人员提供了建议。

与该研究相关的更多资源和开放性问题已在 learningmechanics.pub 网站上发布。