根据 Hugging Face 上的相关文档,DeepSeek AI 已发布 DeepSeek-V4 系列预览版。该系列推出了两款超大规模混合专家(MoE)语言模型,均具备处理百万级上下文长度的能力。

该系列包含两款核心模型:DeepSeek-V4-Pro 是一款重量级模型,总参数量高达 1.6 万亿,其中激活参数为 490 亿;而 DeepSeek-V4-Flash 则更为精简,拥有 2840 亿参数,激活参数为 130 亿。

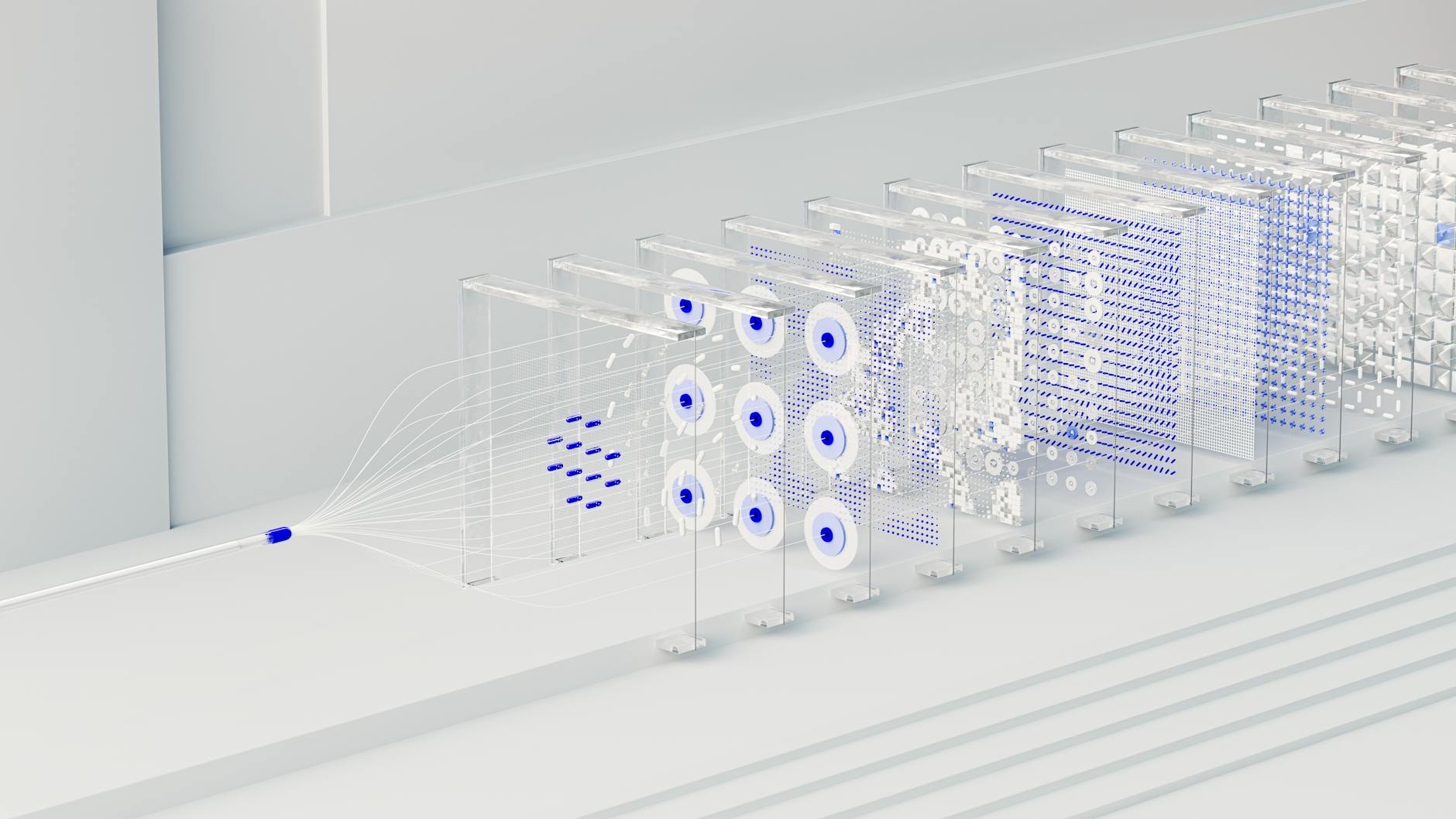

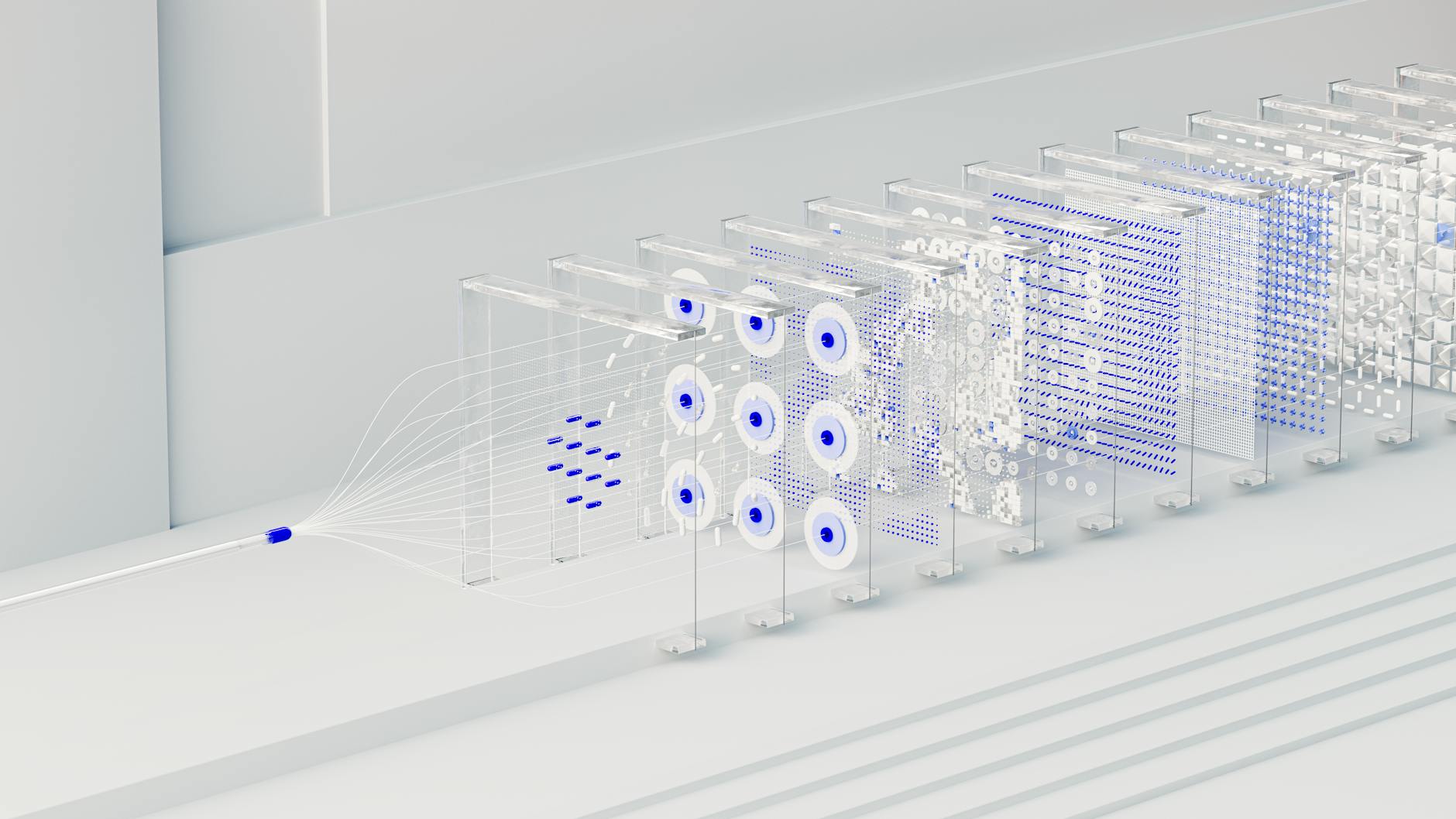

为了有效管理庞大的上下文窗口,开发团队采用了混合注意力机制架构。该系统通过结合压缩稀疏注意力(CSA)与重度压缩注意力(HCA)技术,优化了长文本处理的效率。

技术报告显示,与前代模型 DeepSeek-V3.2 相比,DeepSeek-V4-Pro 在单 Token 推理的 FLOPs 需求上仅为后者的 27%,且 KV 缓存(KV cache)占用也仅为 10%。

先进的训练与优化技术

在预训练阶段,开发团队利用 Muon 优化器实现了更快的收敛速度和更高的训练稳定性。在此阶段,两款模型均在超过 32 万亿个多样化且高质量的 Token 上进行了训练。

后训练过程遵循两阶段范式。DeepSeek 首先通过有监督微调(SFT)以及基于群体相对策略优化(GRPO)的强化学习,来培养特定领域的专家能力。

随后,团队采用在策略(on-policy)蒸馏技术,将这些不同的专业能力整合进一个统一的模型中。这种方法使模型能够集成跨多个领域的专业知识。

DeepSeek 声称,代表 Pro 版本最高推理强度的 DeepSeek-V4-Pro-Max 模式,已成为目前最顶尖的开源模型。公司表示,该模型显著提升了知识处理能力,并在推理和智能体(agentic)任务方面缩小了与领先的闭源模型之间的性能差距。

尽管 Flash 版本规模较小,但开发人员指出,当给予更充足的“思考预算”时,DeepSeek-V4-Flash-Max 的推理性能可以媲美 Pro 版本。然而,受限于较小的参数规模,Flash 模型在处理复杂的智能体工作流和纯知识类任务时,表现自然略逊一筹。

本次发布的模型在 MoE 专家参数上采用了 FP4 与 FP8 混合精度技术。目前,相关模型已可通过 Hugging Face 和 ModelScope 进行下载。