研究人员近日推出了 I-DLM(内省式扩散语言模型),该模型在大幅提升生成速度的同时,其性能已能与传统的自回归(AR)模型相媲美。

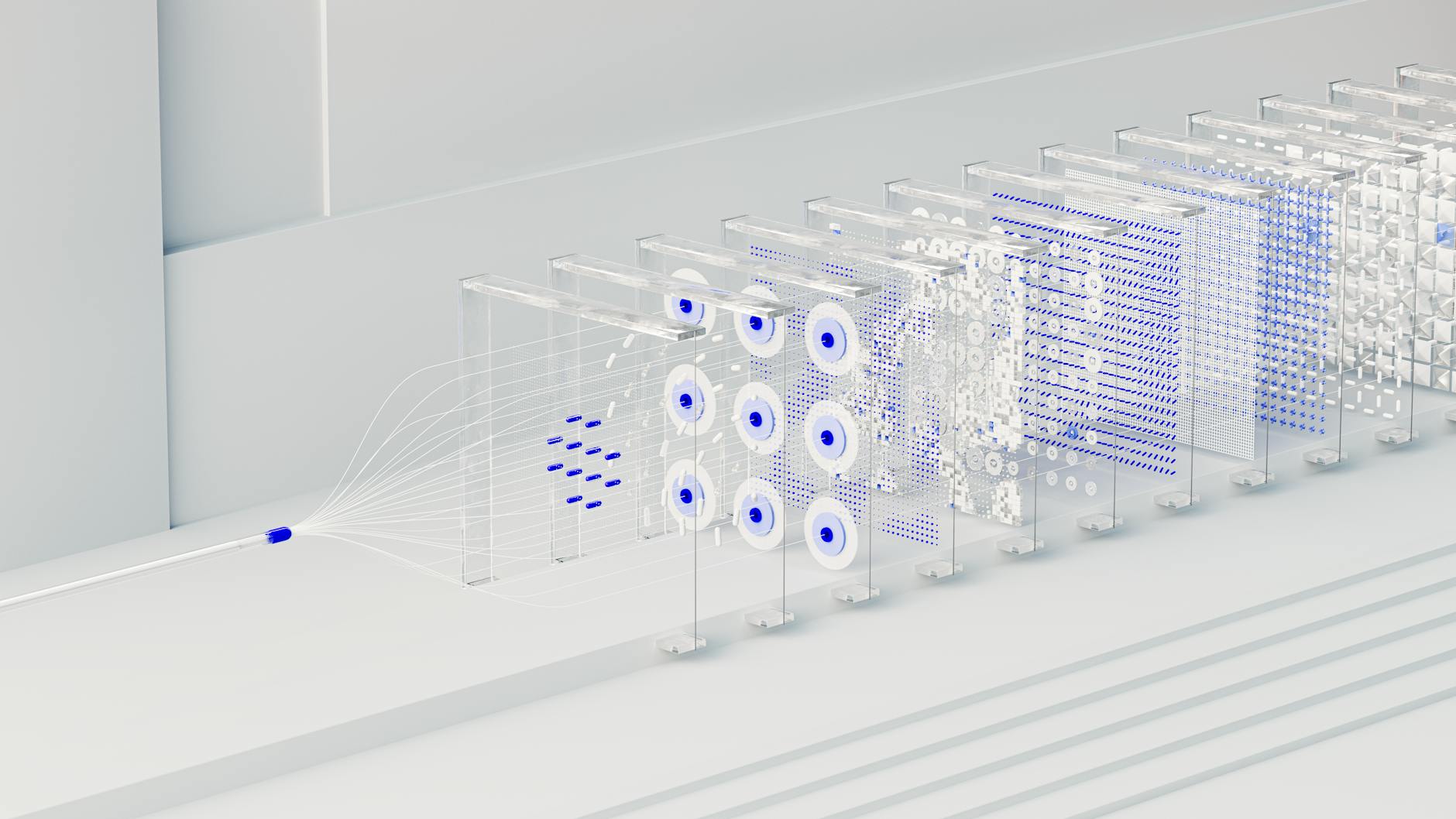

多年来,扩散语言模型(DLM)在生成质量上一直难以与自回归模型一较高下。尽管 DLM 具备并行生成 token 的潜力,有望绕过标准解码的序列化瓶颈,但在推理和编程基准测试中,其表现始终处于劣势。

I-DLM 的开发者认为,这种差距源于“内省一致性”(introspective consistency)的缺失,即 DLM 无法与其生成的 token 保持一致。为解决这一问题,研究团队引入了“内省步进解码”(Introspective Strided Decoding, ISD)技术,该方法能够在单次前向传播中,在推进新 token 生成的同时,对已生成的 token 进行校验。

效率与性能

在基准测试中,I-DLM-8B 模型成为首个在质量上与同规模自回归模型持平的扩散模型。在 AIME-24 数学基准测试中,该 8B 模型取得了 69.6 的高分,显著优于 16B 参数的 LLaDA-2.1-mini(得分为 43.3)。

编程能力方面也实现了巨大飞跃。在 LiveCodeBench-v6 测试中,I-DLM-8B 比 LLaDA-2.1-mini 高出 15 分。尽管参数量仅为后者的一半,但 I-DLM 架构在包括 MMLU 和 GSM8K 在内的 15 项不同基准测试中均保持了极高的准确率。

除了智能水平的提升,该架构在吞吐量方面也展现出巨大优势。在高并发场景下,I-DLM 的吞吐量是标准自回归模型的 2.9 倍至 4.1 倍。研究人员指出,以往的扩散模型(如 SDAR)由于计算效率低下,性能往往会遇到瓶颈;而 I-DLM 的效率反而会随着并发量的增加而相对于自回归模型进一步提升。

该系统设计便于集成,利用因果注意力机制(causal attention)使其能够直接部署在 SGLang 等现有框架中。此外,研究人员还实现了“门控 LoRA”(Gated LoRA)技术,实现了位对位的无损加速,确保模型输出与高质量自回归模型的输出完全一致。