Wiki Education, entidad clave en la captación de nuevos editores para Wikipedia, divulgó los resultados de su investigación sobre el uso de la IA generativa por parte de sus participantes durante 2025. La organización, responsable de cerca del diecinueve por ciento de los nuevos editores activos en la Wikipedia en inglés, buscaba entender las implicaciones de herramientas como ChatGPT y Claude en la integridad enciclopédica.

El hallazgo fundamental reportado por Wiki Education es una advertencia directa: los editores de Wikipedia nunca deben copiar y pegar texto producido por modelos de lenguaje grandes directamente en los artículos. Tras observar patrones estilísticos asociados a la IA, la organización intensificó la vigilancia, enfocándose en la autenticidad de las citas bibliográficas.

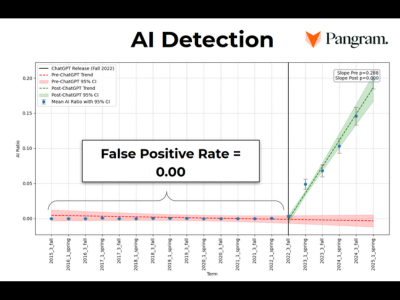

El Director de Tecnología de la entidad, Sage Ross, empleó la herramienta de detección Pangram, encontrándola altamente precisa para el texto de Wikipedia, para analizar más de tres mil artículos creados desde 2022. De los artículos marcados, 178 mostraron indicios de uso de IA, todos posteriores al lanzamiento de ChatGPT en noviembre de 2022, evidenciando un aumento progresivo en la adopción de estas herramientas.

Contrario a las expectativas centradas en las «alucinaciones» de fuentes, solo el siete por ciento de los artículos marcados contenían citas falsas; la información estaba referenciada a fuentes reales y pertinentes. Sin embargo, el problema más grave fue que más de dos tercios de estos contenidos citados fallaron la verificación, ya que la información presentada en Wikipedia no se encontraba en la fuente citada.

Este descubrimiento obligó al personal de Wiki Education a invertir tiempo considerable en la corrección de estos artículos, limpiando contenido que, aunque sonaba plausible, era imposible de verificar o demostrablemente inexacto. La organización ha tomado medidas correctivas, incluyendo mover ediciones recientes a espacios de prueba y someter artículos a procesos de borrado por contenido generado íntegramente por IA.

Como respuesta proactiva, Wiki Education implementó un nuevo módulo de capacitación que enfatiza la prohibición de copiar y pegar resultados de chatbots, y comenzaron a utilizar Pangram casi en tiempo real a través de su plataforma de gestión de cursos Dashboard. Esto permitió emitir alertas automáticas a los participantes que introducían texto detectado como generado por IA.

Durante el segundo semestre de 2025, se generaron 1,406 alertas de edición de IA, aunque solo el veintidós por ciento de estas correspondieron a ediciones en el espacio principal de artículos activos. La mayoría de las detecciones ocurrieron en fases preliminares de los ejercicios, como la creación de bibliografías o esquemas, donde Pangram reportó falsos positivos en contenido no prosaico.