Neuralink está ampliando discretamente su investigación en interfaces cerebro-computadora (BCI, por sus siglas en inglés) para priorizar la tecnología de restauración del habla, lo que marca un posible cambio de estrategia para la empresa dirigida por Elon Musk. Aunque anteriormente Neuralink se centraba en sistemas que permiten a los usuarios controlar cursores mediante la mente, la compañía ahora se enfrenta a competidores que han logrado avances significativos en la traducción directa de la actividad neuronal al habla humana.

Este cambio de rumbo se produce en un momento en que la realidad científica pone a prueba los ambiciosos objetivos iniciales que Musk estableció para la startup. Si bien Neuralink ha logrado implantar chips con éxito en sujetos humanos para facilitar el control motor, el campo en su conjunto ha obtenido resultados más inmediatos y prácticos en las interfaces basadas en el habla.

Del control motor a la comunicación

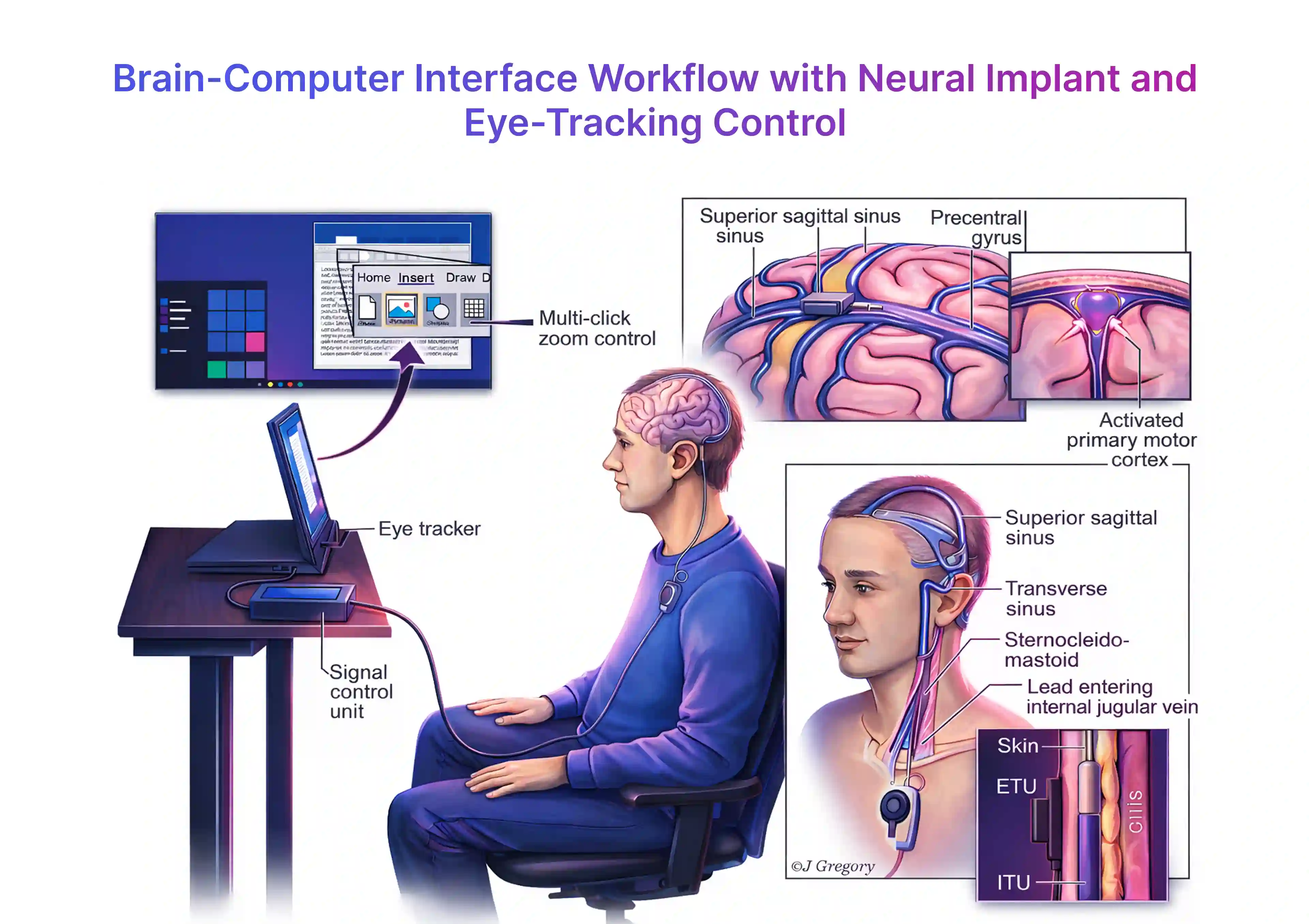

Todas las BCI funcionan detectando señales eléctricas de las neuronas y traduciéndolas en salidas digitales. Sin embargo, la aplicación de esos datos varía considerablemente entre los dispositivos motores y los de habla. Las BCI motoras, como las desarrolladas inicialmente por Neuralink, interpretan las señales destinadas al movimiento de las extremidades para guiar un cursor en la pantalla. Por el contrario, las BCI de habla traducen las ondas cerebrales en fonemas y palabras.

Los últimos años han demostrado la eficacia del enfoque centrado en el habla. En 2024, los investigadores informaron que un paciente con ELA alcanzó un 97 por ciento de precisión utilizando una BCI de habla para comunicarse de forma natural. Estos resultados se han obtenido en un periodo de cinco años, igualando métricas de rendimiento que en el campo de las BCI motoras requirieron dos décadas de trabajo.

La tecnología actual de Neuralink, basada en el control motor, requiere que los pacientes visualicen un movimiento físico para activar una respuesta digital. Por ejemplo, un paciente con ELA podría intentar mover un brazo que ya no puede controlar, y el software interpreta ese intento como una orden para mover el ratón de una computadora. Las BCI de habla operan sobre una base neurológica similar, ya que el cerebro envía señales a los músculos de la lengua y la garganta durante el habla de una manera análoga al movimiento de las extremidades.

Los analistas del sector señalan que la visión más amplia de Musk, centrada en fusionar la cognición humana con la inteligencia artificial, a menudo simplifica las complejas limitaciones fisiológicas de las interfaces cerebrales. Al centrarse en el habla, Neuralink avanza hacia una aplicación más especializada que responde a las necesidades inmediatas de los pacientes. La compañía enfrenta ahora el reto de acortar distancias con sus competidores, quienes han logrado convertir con éxito la decodificación neuronal en una comunicación fluida y en tiempo real para pacientes con discapacidades motoras graves.