Google ha ampliado la disponibilidad de su avanzada tecnología de modelos de mundo con el lanzamiento del Proyecto Genie, permitiendo a los usuarios generar entornos interactivos a partir de una simple fotografía o una descripción textual. Esta herramienta, que anteriormente solo estaba disponible para un grupo reducido de evaluadores, ahora se integra con modelos de IA más recientes como Nano Banana Pro y Gemini 3, según reportó Ars Technica.

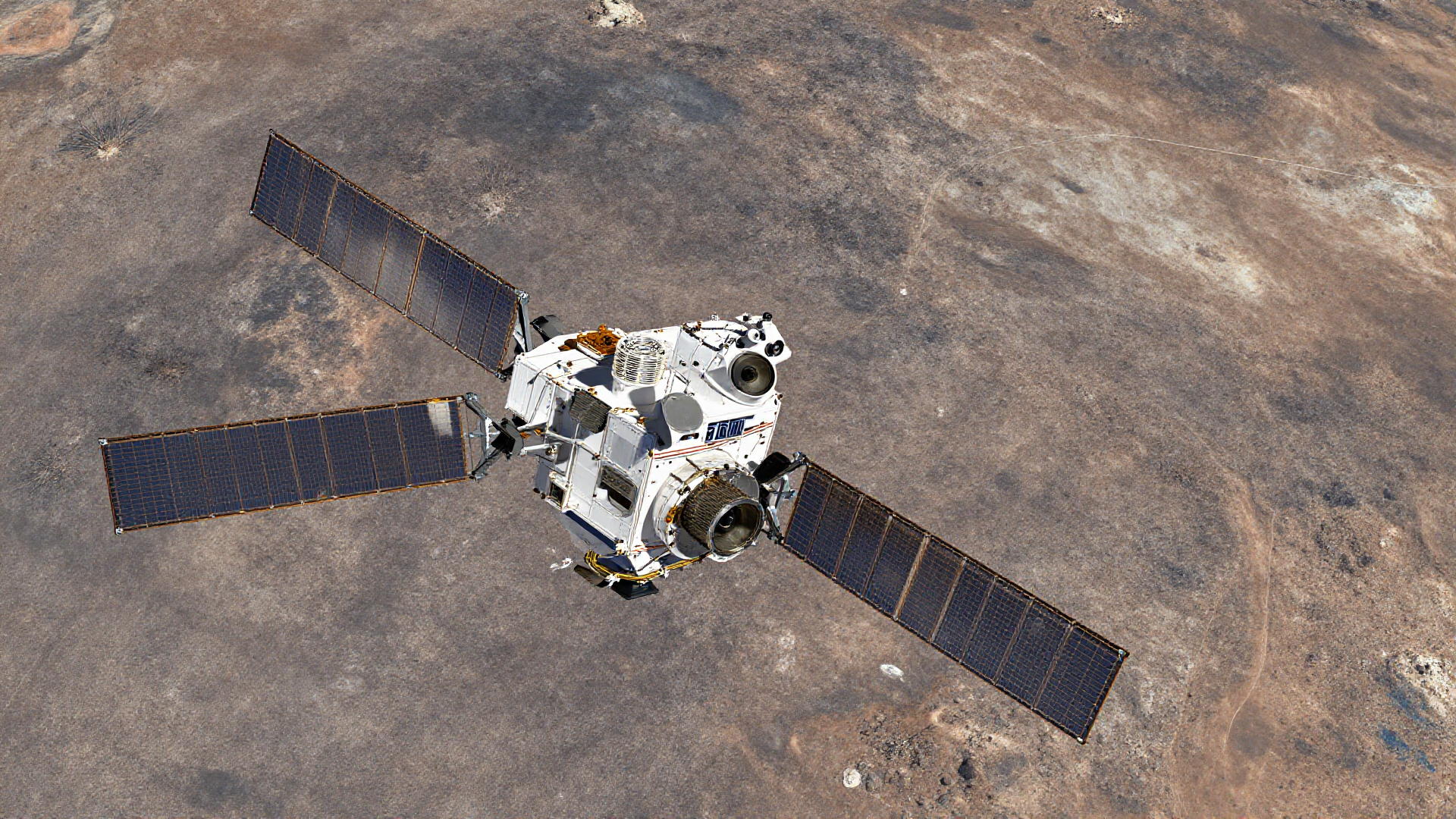

Los modelos de mundo, como evoluciona Genie, no crean mundos tridimensionales en el sentido estricto, sino que generan secuencias de video dinámicas que se adaptan a las entradas de control del usuario. La versión anterior, Genie 3, demostró una capacidad mejorada para mantener la coherencia del mundo durante periodos más largos, aunque limitados a pocos minutos de simulación.

La creación de mundos en el proyecto comienza con lo que Google denomina "esbozo de mundo" (world sketching). El usuario puede proporcionar una imagen inicial o una descripción, y el sistema genera primero una imagen estática que puede ser ajustada antes de iniciar la simulación interactiva. Esta capacidad de refinamiento inicial es clave para guiar la generación del entorno.

Una vez generado el mundo, el usuario puede navegar por la simulación utilizando controles estándar como WASD, con el sistema renderizando el camino por delante en tiempo casi real. La salida de video resultante se entrega a una resolución de 720p, manteniendo una tasa de cuadros de aproximadamente 24 fps durante la exploración activa.

El acceso al Proyecto Genie no es universal; Google ha limitado su disponibilidad a los usuarios que están suscritos a sus niveles de servicio de inteligencia artificial más premium. Esta estrategia de acceso escalonado sugiere que la compañía está midiendo la demanda y la carga computacional antes de una posible distribución más amplia.

Aunque el sistema incluye una biblioteca de mundos preconstruidos, el valor principal reside en la capacidad de los usuarios para definir y explorar sus propias creaciones personalizadas. La integración con modelos fundacionales actuales indica una mejora en la complejidad y la fidelidad visual de los entornos generados.

Este avance consolida la visión de Google sobre la generación de contenido dinámico y controlable mediante IA, moviendo los modelos de texto a imagen hacia simulaciones interactivas que exigen mayor coherencia temporal y espacial. El futuro desarrollo se centrará probablemente en aumentar la duración de la memoria del mundo y mejorar la resolución de renderizado.