Un desarrollador ha presentado un tutor de pronunciación para el mandarín diseñado para ejecutarse completamente en el dispositivo del usuario, abordando la dificultad de los tonos y la falta de retroalimentación inmediata. El sistema se desarrolló tras descartar un enfoque inicial basado en visualización de frecuencia fundamental, que resultó ser demasiado frágil ante el ruido y las variaciones del habla, siguiendo la lección aprendida de que las representaciones aprendidas superan a los sistemas ajustados manualmente con suficientes datos.

El sistema se modeló como una tarea especializada de Reconocimiento Automático del Habla (ASR), utilizando un codificador Conformer entrenado con la pérdida de Clasificación Temporal Conexiónista (CTC). Esta arquitectura combina convoluciones para capturar características espectrales de corto alcance y mecanismos de atención para modelar el contexto de largo alcance, como los tonos relativos del mandarín y el sandhi tonal.

La elección de CTC sobre los modelos secuenciales típicos (como Whisper) fue crucial, ya que CTC obliga al modelo a evaluar lo que se dijo en cada fotograma de audio, en lugar de autocorregir el texto. Para evitar que el sistema de escritura (Hanzi) oculte errores de pronunciación, el vocabulario de salida se definió mediante sílabas Pinyin más el tono, resultando en 1,254 tokens distintos, incluyendo la normalización del tono neutro.

El entrenamiento se realizó utilizando los conjuntos de datos AISHELL-1 y Primewords, sumando cerca de 300 horas, y se completó en aproximadamente 8 horas utilizando cuatro unidades NVIDIA GeForce RTX 4090. El desarrollador logró reducir el modelo inicial de 75 millones de parámetros a uno de 9 millones con una pérdida mínima de precisión, lo que sugiere que la tarea está limitada por la disponibilidad de datos más que por la capacidad de cómputo.

El modelo final de 9M de parámetros pesa aproximadamente 37 MB en punto flotante de 32 bits (FP32), y se redujo a unos 11 MB tras la cuantificación INT8, lo que facilita su carga instantánea a través de onnxruntime-web. Esta eficiencia permite ofrecer una herramienta de aprendizaje estricta y sin conexión, aunque los probadores nativos notaron que requiere una articulación más clara que el habla conversacional.

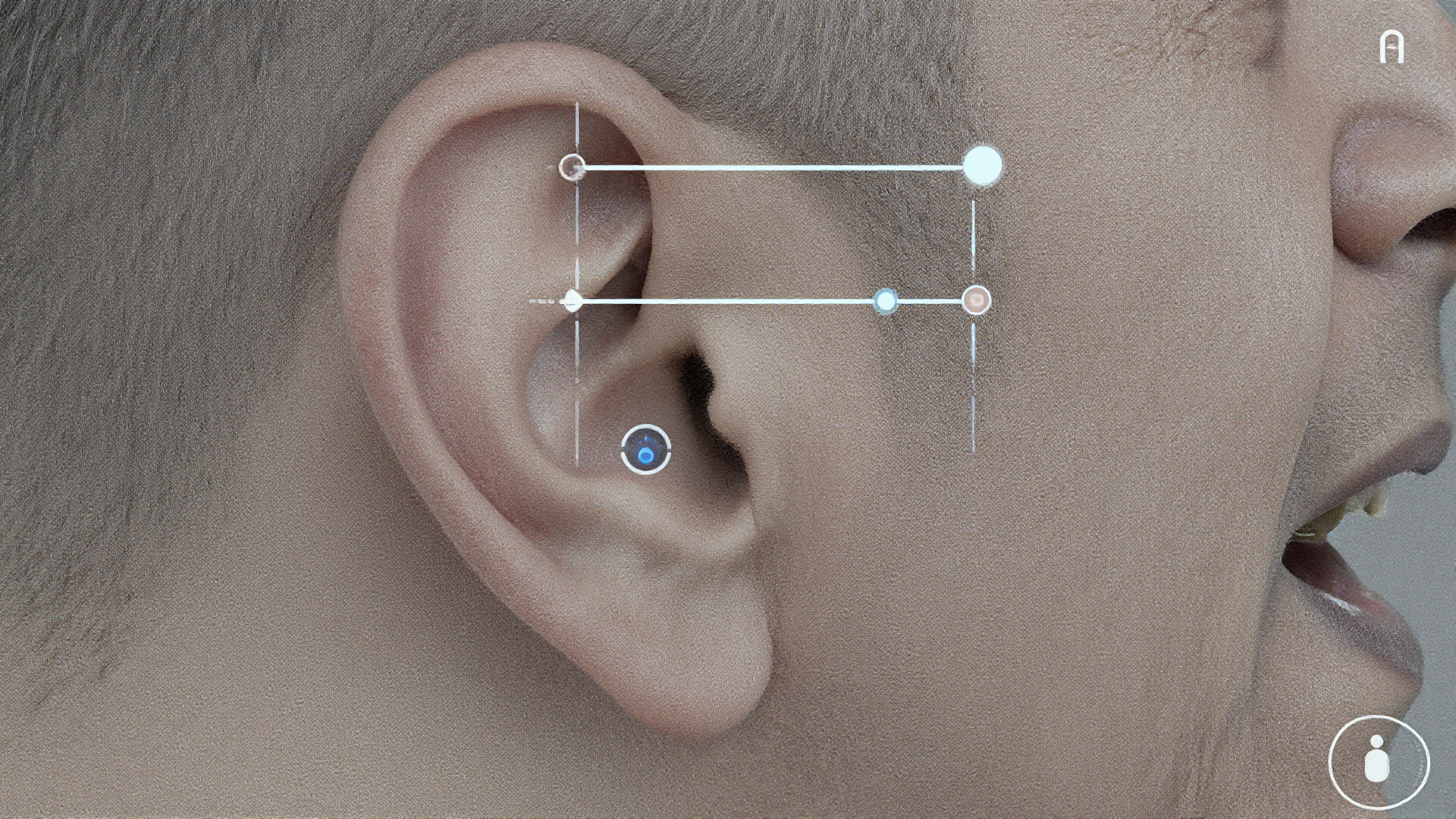

Se resolvió un problema técnico significativo relacionado con la alineación forzada en presencia de silencio inicial, ajustando la lógica para desacoplar los marcos utilizados para la interfaz de usuario de aquellos que contribuyen a la puntuación de confianza. Esta corrección elevó la puntuación de confianza para una sílaba inicial silenciosa de 0.0 a 0.99, mejorando la usabilidad práctica del sistema.

El autor señala que la mejora continua requerirá la incorporación de conjuntos de datos conversacionales, como Common Voice, para abordar el desfase de dominio entre el habla leída utilizada en el entrenamiento y el habla casual. El demo funcional, que se ejecuta íntegramente en el navegador, demuestra la viabilidad de desplegar modelos de aprendizaje profundo especializados y ligeros para la educación lingüística.