计算机专家 Kyle Kingsbury 近日发布了名为《未来皆是谎言》的系列文章,对当前生成式人工智能的发展路径提出尖锐批评。Kingsbury 指出,所谓的大语言模型(LLM)实质上是复杂的机器学习系统,通过处理海量文本向量来预测概率性输出,而非展现出真正的逻辑思维或意识。

概率预测驱动的“即兴表演”

Kingsbury 将 LLM 描述为一台“即兴表演机器”。他分析称,这些模型通过“接着说下去”的逻辑运作,对于事实的准确性并不负责。这种机制导致模型极易产生幻觉,不仅会混淆讽刺与现实,甚至会给出诸如建议用户“在披萨上涂胶水”等荒谬指令。

他认为,大众对“人工智能”这一术语存在严重的认知偏差。由于模型输出的文本在统计学上高度模拟人类语言,用户极易将其误认为具有自我意识。这种交互方式通过将整个对话历史反复输入模型来实现所谓“记忆”,而非模型本身具备了学习或存储能力。

自 2019 年以来,Kingsbury 便开始关注此类技术带来的伦理风险。他曾在某云服务商的讲座中提问,指出降低深度学习的成本与门槛,将不可避免地催生大规模垃圾信息与政治宣传工具。五年后,他认为这一担忧已成为现实,且技术生态中充斥着盲目的推崇,缺乏对负面影响的深刻审视。

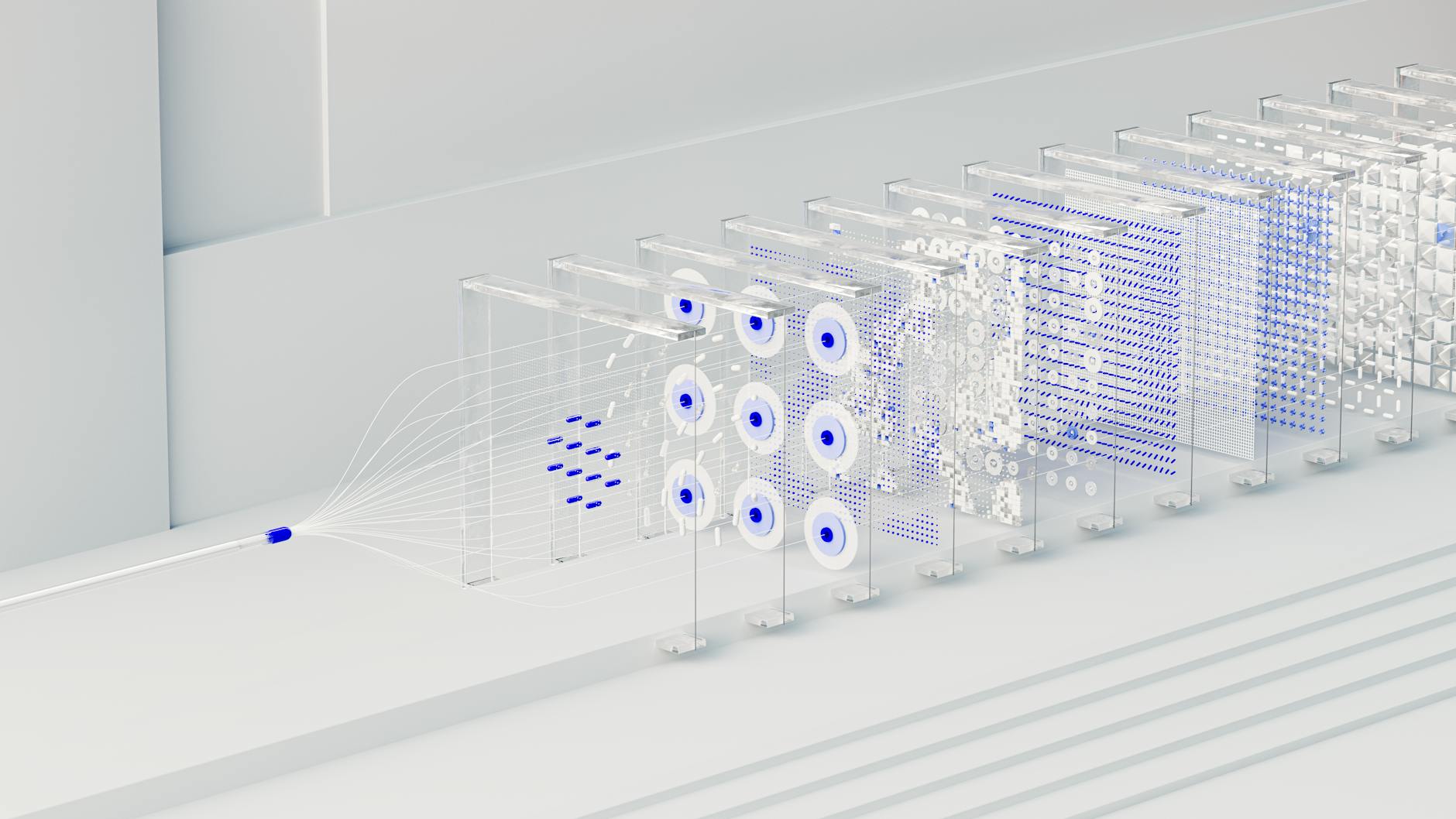

该研究强调,这类模型的训练过程依赖于大规模抓取网络内容,甚至包含大量盗版书籍与受版权保护的素材。一旦训练完成,模型便进入推理阶段,不断重复其概率性预测逻辑。Kingsbury 表示,尽管一些模型可以通过操作员的反馈进行微调,但它们本质上并未在交互中进化,依然是基于线性代数的计算堆栈。

Kingsbury 在文中写道:“这全是关于胡言乱语机器的胡言乱语。”他指出,自己撰写此文的目的,是为了填补当前 AI 舆论场中被忽视的负面空间,反驳那些脱离技术本质的过度炒作。